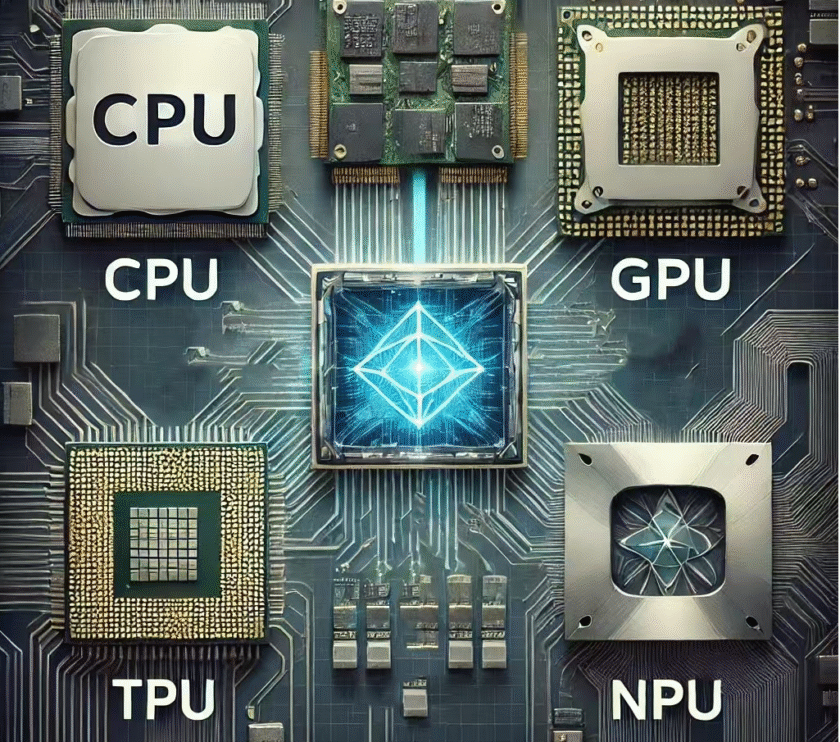

Những tác vụ này quá nặng nếu chỉ xử lý bằng CPU truyền thống. Vì thế, chip chuyên dụng cho AI ra đời – trong đó nổi bật là GPU, TPU, và NPU.

Tại sao AI cần những con chip riêng biệt?

Trí tuệ nhân tạo, đặc biệt là các mô hình học sâu (deep learning), đòi hỏi khả năng tính toán ma trận cực lớn – có thể lên đến hàng tỷ phép tính mỗi giây. Các phép toán chủ yếu là:

- Nhân ma trận (matrix multiplication)

- Tích chập (convolution)

- Học trọng số (backpropagation)

1. GPU (Graphics Processing Unit) – “Người hùng bất đắc dĩ” của AI

✅ Ban đầu dành cho game

GPU được thiết kế để xử lý đồ họa 3D, video và game. Nhưng vì có hàng ngàn lõi nhỏ, GPU vô tình rất phù hợp để xử lý song song khối lượng lớn dữ liệu, đặc biệt là ma trận – điều mà deep learning rất cần.

💡 GPU trong AI

- Huấn luyện mô hình AI lớn: GPT, BERT, Stable Diffusion…

- Inference (suy luận): Dự đoán đầu ra khi mô hình đã huấn luyện

🔧 Hãng nổi bật:

- NVIDIA – Thống trị thị trường với các dòng A100, H100, RTX 40xx, CUDA

- AMD – Dòng MI300 đang cạnh tranh mạnh

- Intel – Tham gia với GPU Ponte Vecchio, nhưng chưa phổ biến

2. TPU (Tensor Processing Unit) – Vũ khí bí mật của Google

✅ Ra đời để phục vụ AI

Google nhận thấy GPU chưa đủ tối ưu cho deep learning, nên họ tự thiết kế một loại chip riêng: TPU, ra mắt từ năm 2016.

🔬 Tối ưu cho TensorFlow

TPU được xây dựng để chạy TensorFlow – framework AI do chính Google phát triển. Nó rất hiệu quả trong các tác vụ nhân tensor (tensor là ma trận nhiều chiều, dữ liệu cơ bản của AI).

📦 Ứng dụng

- Chạy mô hình AI cho Gmail, Google Translate, Google Photos

- Cung cấp TPU qua nền tảng Google Cloud AI

- Một TPU thế hệ mới có thể chạy hàng triệu truy vấn AI mỗi giây

🔧 Đặc điểm

| Tiêu chí | GPU | TPU |

|---|---|---|

| Mục đích | Đa năng (game, AI, đồ họa) | Duy nhất cho AI |

| Linh hoạt | Cao | Thấp (nhưng nhanh hơn nếu đúng tác vụ) |

| Tối ưu hóa | Khá tốt | Cực kỳ tốt cho TensorFlow |

3. NPU (Neural Processing Unit) – Chip AI cho thiết bị di động

✅ Dành cho AI tại thiết bị (Edge AI)

Khác với GPU và TPU chủ yếu phục vụ trên cloud/server, NPU được thiết kế để đưa AI đến thiết bị đầu cuối như:

- Điện thoại thông minh

- Đồng hồ thông minh

- Ô tô thông minh

- Thiết bị IoT

📲 Ứng dụng phổ biến

- Nhận diện khuôn mặt (Face ID – iPhone)

- Tối ưu hình ảnh/video bằng AI

- Dịch ngôn ngữ offline

- Điều khiển bằng giọng nói không cần internet

🔧 Hãng sản xuất NPU

| Hãng | Chip NPU |

|---|---|

| Apple | Neural Engine (trong chip A-series & M-series) |

| Huawei | Da Vinci NPU |

| Samsung | Exynos AI Processor |

| Qualcomm | Hexagon DSP/NPU trong Snapdragon |

🎯 So sánh tổng quan GPU vs TPU vs NPU

| Tiêu chí | GPU | TPU | NPU |

|---|---|---|---|

| Đơn vị phát triển | NVIDIA, AMD, Intel | Apple, Qualcomm, Huawei… | |

| Mục tiêu | Đa năng + AI | AI chuyên biệt | AI trên thiết bị nhỏ |

| Tối ưu cho | ML, DL, game | TensorFlow | Edge AI |

| Khả năng mở rộng | Cao (dùng nhiều GPU) | Rất cao (TPU Pod) | Thấp hơn |

| Chi phí | Trung bình – cao | Cao, theo Google Cloud | Rẻ hơn, tích hợp sẵn |

| Độ linh hoạt | Rất cao | Trung bình | Thấp |

📈 Tương lai: Kết hợp cả 3 trong cùng hệ thống

Một xu hướng đang nổi là hợp nhất nhiều loại bộ xử lý AI:

- Hệ thống cloud dùng TPU/GPU để huấn luyện

- Thiết bị đầu cuối dùng NPU để chạy AI offline

- Các chip SoC (System on Chip) tích hợp CPU + GPU + NPU trên một đế silicon

Ví dụ: Apple M4 mới ra mắt tích hợp CPU, GPU và 16-core Neural Engine – có thể thực hiện tới 38.000 tỷ phép toán mỗi giây (TOPS), phục vụ cho tính năng như Apple Intelligence (AI nội bộ không cần cloud).

Kết luận

AI không thể bùng nổ nếu không có phần cứng đi kèm. GPU, TPU và NPU chính là ba loại “động cơ” đang chạy đua để cung cấp năng lực tính toán khổng lồ cho kỷ nguyên AI.

Hiểu sự khác biệt giữa chúng sẽ giúp bạn:

- Lựa chọn hạ tầng phù hợp (cloud hay edge)

- Tối ưu hiệu năng cho dự án AI

- Đón đầu xu hướng chip AI chuyên biệt theo từng lĩnh vực

>>> Bài trước: Vì sao công nghệ bán dẫn là nền tảng sống còn cho trí tuệ nhân tạo?

RELATED Posts